Nello storage per avere successo non basta più avere prodotti evoluti e dalle prestazioni elevate; oggi è necessario disporre della padronanza di un altro elemento che si va rivelando sempre più fondamentale per guadagnare attenzione sul mercato: gli economics. L’importante annuncio è stato fatto da Hubert Yoshida, Vice President e Chief Technology Officer di Hitachi Data Systems alla stampa in occasione di un suo breve soggiorno a Milano. “E’ nostra ferma e convinta decisione applicare d’ora in poi – ha puntualizzato – i principi economici e finanziari allo storage, allo scopo di mettere i clienti nella migliore condizione per valutare i loro investimenti e i ritorni degli stessi. Siamo convinti che i supporti di storage siano un asset importante dei budget It anche in questo periodo tormentato e vogliamo dimostrare la loro validità con argomentazioni non solo di valenza tecnologia ma primariamente di natura economica , per dare ai nostri clienti la certezza di investire bene il loro denaro”. Il nuovo approccio sviluppato da HDS si articola su più livelli: quantificare e comunicare i risparmi realizzabili nella gestione operativa; usare il TCO (Total Cost of Ownership) per misurare e fare comparazioni; usare l’indice ROA (Return On Assets) per giustificare i costi; applicare come detto le regole della misurazione contabile ai diversi step che caratterizzano il processo di storage, dalle architetture alla gestione fino al comportamento nella fase di consumo.

“Riteniamo le misurazioni – ha sottolineato Yoshida – una condizione oggi fondamentale da parte di chi offre storage di qualità. Non è possibile fare miglioramenti se non si misurano le stesse. Oggi abbiamo deciso di comunicare al mercato questo approccio anche se per noi è un elemento topico dal 2002. Basta accedere al siti www.StorageEconomics.com come al nostro blog http://blogs.hds.com/david/ per avere conferme”.

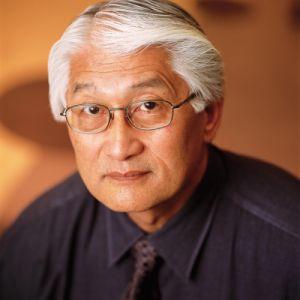

Hubert Yoshida è un personaggio importante. Il suo compito in HDS è quello di definire le strategie di ricerca e sviluppo, nell’ottica di realizzare soluzioni che consentano ai clienti di soddisfare le proprie esigenze di Data Life Cycle Management, nel pieno rispetto delle normative e della corporate governance. Ha giocato un ruolo fondamentale nella diffusione dell’approccio HDS alla virtualizzazione, realizzato attraverso i servizi di storage della Universal Storage Platform e i sistemi ad esse collegati. La virtualizzazione è una delle leve usate dalla società giapponese per cogliere i risultati che abbiamo detto sopra, unitamente al rispetto degli standard aperti e alla scalabilità delle sue soluzioni. Concetto quest’ultimo sintetizzato nella frase “Scale up can be partitioned to work like scale out” di cui Yoshida ha fatto largo uso durante il suo speech.

In definitiva sono tre i megatrend che dominano la scena dello storage e soprattutto stanno avendo un impatto rilevante sul suo sviluppo. Al primo posto sta un concetto basilare valido per tutto il settore: la modalità di spesa per l’It sta cambiando; il secondo è il fenomeno dei dati che sta esplodendo oltre le previsioni; il terzo trend riguarda l’attività di computing, in preda uno tsunami tecnologico vero e proprio. Vale la pena fare proprio alcune delle considerazioni del guru dello storage. Il mutamento nello spending ha come artefice la virtualizzazione, che nella visione di Hitachi è vista associata o come sinonimo del cloud. In un contesto di mercato che vede la spesa hardware piatta e quella dei costi operativi crescere, la virtualizzazione consente di ridurre anche questi ultimi, ingenerando un meccanismo che, unitamente al provisioning dinamico (cloud incluso), impatta significativamente sulla spesa complessiva. I dati stanno crescendo, sulla base delle più recenti rilevazioni, a un tasso del 66% l’anno, con una punta del 121% per i contenuti, mentre per i dati strutturati il cagr è del 32%. Dal lato prodotti la diffusione di server virtuali e di rete richiedere una scalabilità verso l’alto nelle soluzioni di storage che si materializzano sotto forma di nuove architetture (grazie soprattutto ai sempre più potenti processori Intel) e di nuova capacità di operatività in rete.